Claude Code vs Codex —「どっちがいい?」という問い自体が間違い

Claude CodeとCodex、どっちが優秀か。

半年前、自分もまったく同じことで悩んでいました。

Xで「Claude Codeすごい」というポストを見た翌日に「Codexヤバい」が流れてきて、どちらに課金すべきか決められない。スペック比較記事を3本読んでも、結局わからない。

で、両方に課金しました。

Cursor・Claude Code・Codex・Gemini CLIの4つを同時に立ち上げて開発する生活を半年続けた結果、はっきり見えたことがあります。

この2つは「上位互換」の関係ではなく、得意な仕事がまるで違います。

2026年のClaude Code:慎重で丁寧な参謀

Claude Codeはこの1年で大きく変わりました。

CLI・VS Code拡張・Webの3形態に対応し、モデルもOpus 4.6に進化。

自分はVS Code拡張をメインにしています。

| 項目 | 内容 |

|---|---|

| モデル | Sonnet 4.6 / Opus 4.6 |

| 料金 | Pro $20/月 / Max $100・$200/月 |

| 利用形態 | CLI / VS Code拡張 / Web |

| コンテキスト | 最大200Kトークン |

| マルチエージェント | Agent Teams(協調型) |

| SWE-bench Pro | 59.0% |

一言で表すなら、慎重な参謀です。

コードを書く前にまず既存コードを読む。

危ないコマンドは「これ実行していいですか?」と聞いてくる。

公式が掲げる設計思想は”measure twice, cut once”(二度測って、一度で切る)。

正直、最初はイラッとしました。「いちいち聞いてくるな」と。

ところがプロジェクトが500ファイルを超えたあたりから、この慎重さに助けられる場面が増えました。

リファクタリングで既存のテストを壊さない。

型定義を勝手に変えない。信頼できる同僚がペアプロしてくれる感覚に近いです。

2026年のCodex:自走する実行者

Codexも進化がすさまじい。

macOSアプリ・CLI・ChatGPT統合に拡大し、モデルはGPT-5.3-Codexに刷新されています。

| 項目 | 内容 |

|---|---|

| モデル | GPT-5.3-Codex / Spark |

| 料金 | Plus $20/月 / Pro $200/月 |

| 利用形態 | macOSアプリ / CLI / ChatGPT |

| マルチエージェント | Sub-agents(並列独立型) |

| Terminal-Bench | 77.3% |

一言で表すなら、自走する実行者。

タスクを投げると、サンドボックスの中で勝手に動き始めます。

ファイルを読み、テストを書き、エラーが出たら自分で直す。

こちらが見ていなくても、完了したら結果が返ってくる。

設計思想は”move fast and iterate”。

Claude Codeとは真逆です。

ターミナル操作も強い。

Terminal-Benchで77.3%という数値は、Claude Codeの65.4%を大きく上回っています。

シェルスクリプトやCI/CDの修正では、体感でもCodexの方が手早いです。

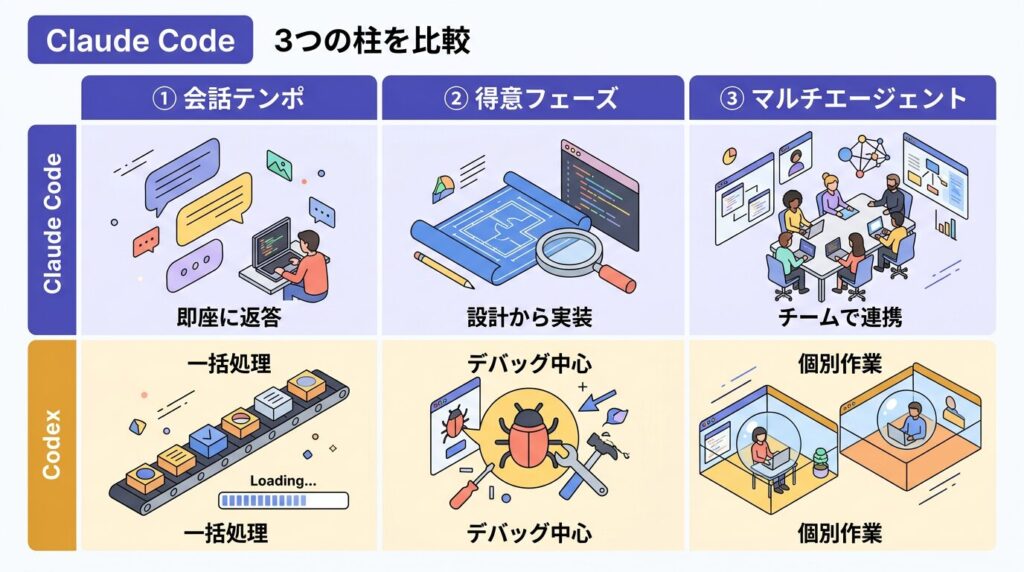

Claude CodeとCodexを使ってわかった3つの決定的な違い

スペック表を並べても見えないのが、実際に使ったときの「手触り」の違いです。

半年使って明確になった3つを書きます。

1. 会話のテンポが違う

Claude Codeは対話型。

作業しながら「この方針でいいですか?」と確認してくる。

壁打ち相手のように、こちらの意図を汲もうとするコミュニケーションがあります。

Codexはバッチ型。

指示を出したら走り出す。

途中で「やっぱりこっちで」と変えるのは難しい。

代わりに、複数タスクを同時に走らせられます。

ぶっちゃけ、これが一番大きな違いです。

「まだ方針が固まっていないとき」にCodexに投げると、高速で見当違いのものが返ってくる。

逆に「やることが明確なバグ修正」をClaude Codeに頼むと、確認の往復が多くてもどかしい。

2. 得意なフェーズが違う

開発は「設計 → 実装 → 修正 → レビュー」の流れがあります。

Claude Codeは設計と実装が強い。

コードベース全体を読んで、既存パターンに合わせた提案をしてくれます。

「このプロジェクトではこう書いてるから、合わせますね」が自然にできる。

200Kトークンのコンテキストが効いています。

Codexは実装と修正が速い。

テストが通るまで自動リトライするので、「とにかく動くコード」を手に入れるスピードが段違いです。

自分の場合、新機能はClaude Codeで作り、そのコードのレビューをCodexに回すことがあります。

書いたAIと別のAIでレビューすると、前提を共有していないからこそ見つかるバグがある。

この発想は複数のAIをオーケストレーションするという発想で詳しく書きました。

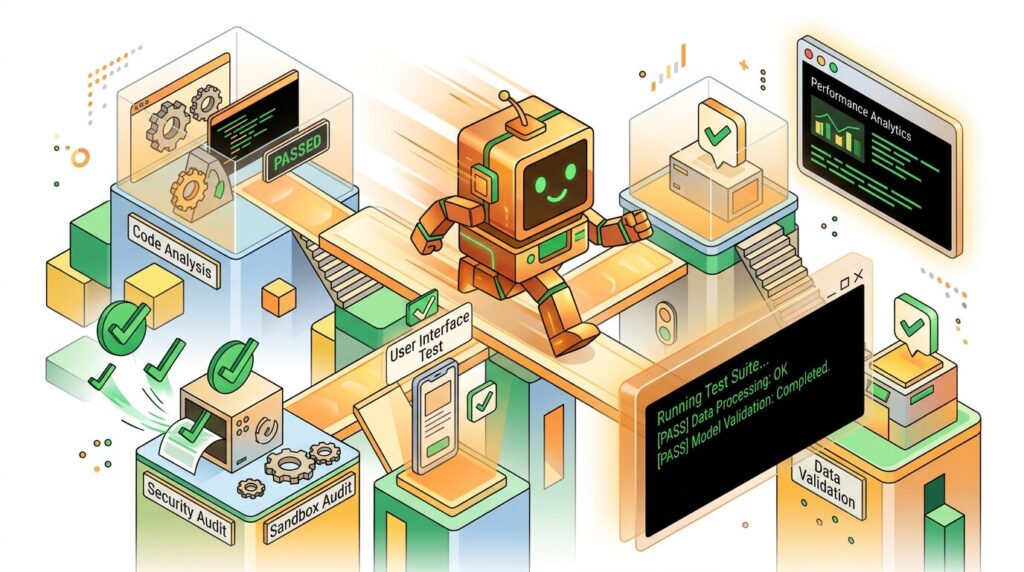

3. マルチエージェントの思想が違う

2026年の大きな変化が「マルチエージェント対応」です。

ただ、アプローチが対照的。

Claude CodeのAgent Teamsは協調型です。チームメイトがメッセージをやり取りし、共有タスクリストで進捗を管理する。人間のチーム開発に近い。

たとえば「フロントエンドを担当するエージェント」と「バックエンドを担当するエージェント」がAPIの仕様について相談しながら進む、というイメージです。

CodexのSub-agentsは並列独立型。

それぞれが別のサンドボックスで動き、結果だけを集約する。

マイクロサービス的な発想です。

10個のバグ修正を同時に走らせて、全部終わったらまとめてPRを出す、という使い方に向いています。

密な連携が要るリファクタリング → Agent Teams。

独立して分割できるバグ修正 → Sub-agents。

タスクの性質で選びます。

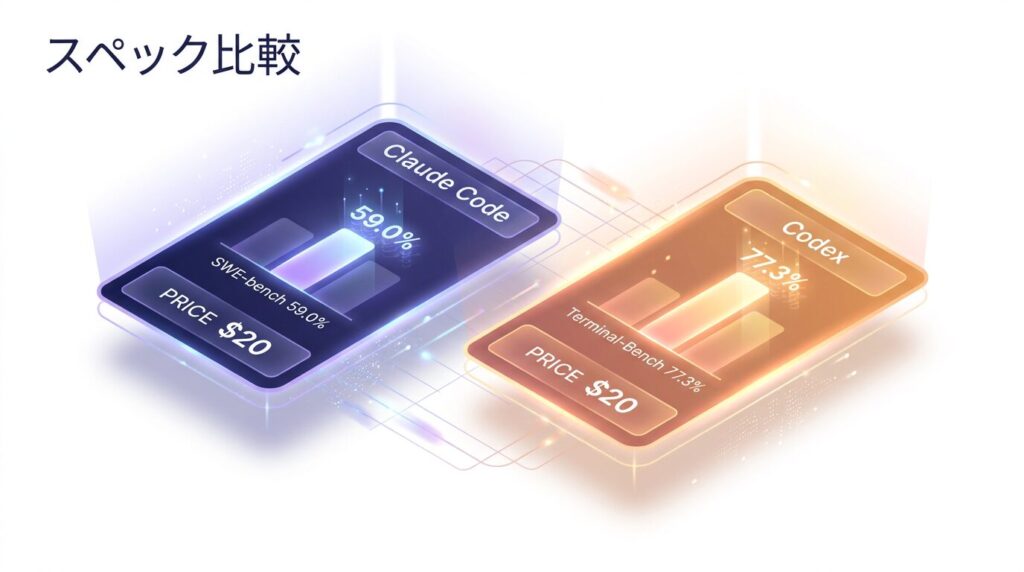

Claude Code vs Codex スペック比較表(2026年3月時点)

| 項目 | Claude Code | OpenAI Codex |

|---|---|---|

| 提供元 | Anthropic | OpenAI |

| 代表モデル | Opus 4.6 / Sonnet 4.6 | GPT-5.3-Codex / Spark |

| 料金 | Pro $20 / Max $100・$200 | Plus $20 / Pro $200 |

| 利用形態 | CLI / VS Code / Web | macOS / CLI / ChatGPT |

| 設計思想 | 対話型・慎重 | 自律型・高速 |

| SWE-bench Pro | 59.0% | 56.8% |

| Terminal-Bench | 65.4% | 77.3% |

| マルチエージェント | Agent Teams(協調型) | Sub-agents(並列型) |

| 得意フェーズ | 設計・実装 | 実装・修正 |

Claude CodeとCodex、結局どう使い分ければいいのか

自分の使い分けを表にします。

| 場面 | 選択 | 理由 |

|---|---|---|

| 新機能をゼロから作る | Claude Code | 設計パターンを理解した提案が出る |

| バグ修正・テスト追加 | Codex | 自動リトライで速い |

| リファクタリング | Claude Code | 既存コードを壊さない慎重さ |

| インフラ・シェル操作 | Codex | Terminal-Benchの数値通り |

| コードレビュー | 書いたのと違うAI | 前提を共有していない視点が価値 |

ポイントは、1つに絞ろうとしないこと。

月額$20ずつ、合計$40で両方使えます。

片方だけに固執して「こっちは○○が苦手だな」と不満を抱えるより、苦手な仕事をもう片方に回す方が建設的です。

AI自動化ツールの比較と選び方でも書きましたが、ツール選びは「ベストワンを見つける」より「組み合わせを設計する」時代に入っています。

Claude CodeかCodex、まずは「もう1つ」を試してみる

すでにClaude Codeを使っているなら、Codexを。

Codexを使っているなら、Claude Codeを。

同じタスクを両方に投げてみてください。

それだけで「あ、こっちはこういうアプローチなのか」と体感できます。

スペック表を比較しているだけでは絶対にわからない、手触りの違いが1回で伝わります。

自分の場合、4つのAIを使い分ける中で知識管理の仕組みそのものが変わりました。

道具が増えると、使い方だけでなく仕事の進め方自体が変わる。

「どっちがいい?」ではなく「どう組み合わせるか?」。

その視点に切り替わった瞬間が、AIツール活用の本当のスタートラインだと思います。

参考になれば幸いです。